一文读懂系统间数据对接传输 从设计到实施的全链路解析

在数字化时代,企业信息系统往往不是孤立存在的。多个系统间的高效、稳定、安全的数据流转,是支撑业务流程连续性的关键。系统间数据对接传输,即信息系统集成服务,已成为企业IT架构中不可或缺的一环。本文将系统性地解析如何设计并实施一个稳健的数据对接传输方案。

一、 核心目标与设计原则

在开始设计前,必须明确数据对接的根本目标:

- 数据一致性:确保数据在源系统与目标系统之间准确、完整地同步,避免信息孤岛。

- 实时性/准实时性:根据业务需求(如订单处理、库存更新),确定数据同步的时效要求(T+0实时、T+1批处理等)。

- 可靠性:具备容错、重试、监控机制,确保在异常情况下数据传输不丢失、不重复。

- 安全性:保障数据传输过程(加密)与数据内容(脱敏、权限控制)的安全。

- 可扩展性与解耦:对接架构应能适应未来系统增减的变化,且系统间应尽可能松耦合,避免“牵一发而动全身”。

核心设计原则:标准化、模块化、可监控、可回溯。

二、 关键设计步骤与考量

1. 需求分析与接口契约定义

- 范围梳理:明确对接的系统双方、需传输的数据实体(如客户、订单、产品)及具体字段。

- 交互模式确定:

- 推送 (Push):由数据源系统主动发起,如事件驱动。适用于实时性要求高的场景。

- 拉取 (Pull):由数据消费方定时或按需查询获取。适用于对源系统压力敏感的场景。

- 混合模式:结合两者优势。

- 接口契约制定:这是设计的基石。需明确定义:

- 数据格式:JSON、XML 还是定长/分隔符文本?JSON因其轻量和易解析性已成为主流。

- 传输协议:HTTP/S(RESTful API)、消息队列(如Kafka、RocketMQ)、WebService、数据库直连、文件(SFTP)等。

- 接口规范:API的URL、方法(GET/POST/PUT)、请求/响应结构、状态码、错误信息格式。

- 安全认证:Token、API Key、OAuth 2.0等。

2. 技术选型与架构设计

- 传输层技术选择:

- API调用:适用于请求-响应式、实时同步的场景。RESTful API设计是当前首选。

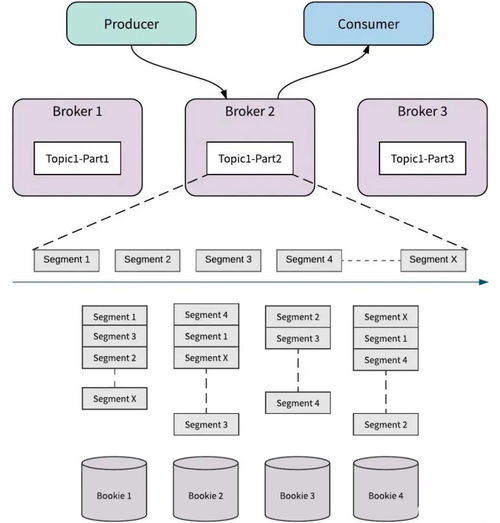

- 消息队列:适用于异步、解耦、流量削峰、一对多广播的场景。能有效提升系统整体可靠性与扩展性。

- ETL工具:适用于传统数据仓库、大数据平台与业务系统间复杂的批量数据抽取、转换和加载。

- 文件传输:适用于与外部合作伙伴、或对实时性要求不高的海量数据交换。

- 数据格式与序列化:定义清晰、版本化的数据模型(Schema)。使用JSON Schema或Protobuf IDL等工具进行约束和描述。

- 架构模式:

- 点对点直连:简单直接,但耦合度高,难以维护扩展。

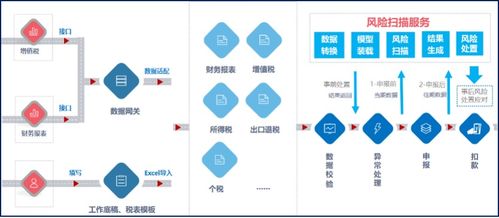

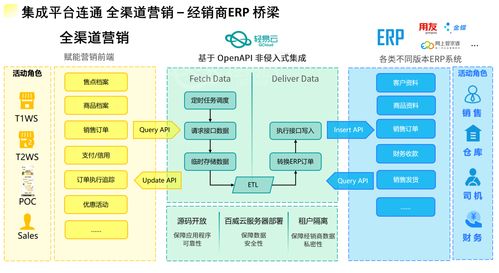

- 基于ESB(企业服务总线)/iPaaS(集成平台即服务):集中化管理所有接口,提供协议转换、路由、监控等通用能力,是复杂企业集成的理想选择。

- 基于API网关:专注于API生命周期的管理,适用于微服务架构或对外开放API的场景。

3. 核心功能模块设计

- 数据转换与映射:设计转换规则引擎,处理源和目标系统间字段名、格式、值域的差异。

- 异步与可靠传输:

- 幂等性设计:确保同一操作执行多次的结果与执行一次相同,防止网络重试导致的数据重复。

- 重试与死信队列:对失败消息进行有策略的重试,最终仍失败的消息进入死信队列供人工干预。

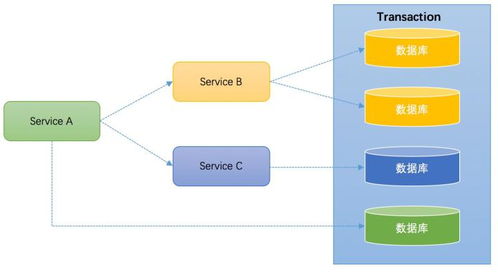

- 事务与补偿:对于涉及多步的操作,设计最终一致性方案或补偿事务(如Saga模式)。

- 监控与运维:

- 链路追踪:记录数据从产生到消费的全链路,便于问题定位。

- 日志与审计:详尽记录接口调用、数据流转日志,满足合规审计要求。

- 监控告警:对接口响应时间、成功率、数据量等关键指标进行监控,设置阈值告警。

三、 实施流程与最佳实践

- 分阶段实施:从优先级最高的核心接口开始,采用“试点-推广”模式。

- 环境管理:严格区分开发、测试、预生产、生产环境。

- 版本管理:接口必须具备向后兼容性,或制定明确的版本升级与下线流程。

- 全面测试:包括单元测试、接口集成测试、性能压测、异常场景测试(如网络中断、数据异常)。

- 文档化:维护实时更新的接口文档(如使用Swagger/OpenAPI),并记录所有设计决策。

- 上线与灰度发布:新接口上线建议采用灰度发布,先引导少量流量,验证稳定后再全量切换。

四、 常见挑战与应对策略

- 性能瓶颈:通过异步化、批处理、数据分页、缓存、优化查询语句等方式应对。

- 数据质量:在接口层增加数据清洗、校验规则,从源头保障数据质量。

- 系统异构:利用ESB/iPaaS或自定义适配器进行协议与数据格式的转换。

- 变更管理:建立严格的变更沟通机制,任何一方的接口变更需提前通知并协同测试。

###

设计系统间数据对接传输,远不止于技术实现。它是一个结合了业务理解、架构设计、项目管理与运维保障的综合性工程。成功的集成方案始于清晰的契约、成于稳健的架构、久于严格的运维。遵循标准化、模块化、面向失败设计的原则,构建一个灵活、可靠、可视化的数据流转通道,方能真正释放企业数据的聚合价值,为业务创新奠定坚实的数据基石。

如若转载,请注明出处:http://www.songguoxinli.com/product/38.html

更新时间:2026-04-20 13:24:01